Używasz narzędzi AI? Uważaj, ta pułapka może cię sporo kosztować

Sztuczna inteligencja w pewnym sensie domyka ściany własnego ekosystemu. Najnowsze dane z rynku wyszukiwarek, udostępnione przez Semcore, malują obraz cyfrowego giganta, który w pogoni za zatrzymaniem użytkownika u siebie, zaczyna faworyzować własne treści kosztem niezależnych wydawców.

- Ekosystem, który nie chce wypuścić użytkownika

- Amerykański filtr i algorytmiczne halucynacje

- Nowa era rywalizacji o udział w odpowiedziach AI

Ekosystem, który nie chce wypuścić użytkownika

Mechanizm działania współczesnych wyszukiwarek ewoluuje w stronę modelu „zero-click”, gdzie odpowiedź na zapytanie pojawia się bezpośrednio na ekranie, eliminując potrzebę odwiedzania zewnętrznych witryn. To zjawisko przybiera na sile wraz z rozwojem trybów generatywnych. Analizy przeprowadzone przez agencję analityczną SE Ranking na próbie 10 tysięcy słów kluczowych rzucają nowe światło na skalę tego procederu. Jeszcze w czerwcu 2025 roku udział autocytowań Google w trybie AI Mode wynosił skromne 5,7%. Obecnie wskaźnik ten wystrzelił do poziomu 17,42%, co oznacza niemal trzykrotny wzrost w czasie krótszym niż rok. W praktyce co szóste źródło, na które powołuje się sztuczna inteligencja, jest zasobem należącym do samego giganta z Mountain View. To nie tylko zmiana techniczna, ale fundamentalna reforma sposobu, w jaki dystrybuowany jest ruch w sieci.

Struktura odnośników wewnątrz odpowiedzi generowanych przez AI również budzi niepokój. Choć 59% linków wciąż prowadzi do tradycyjnych wyników wyszukiwania, to już ponad jedna trzecia (ok. 34%) kieruje użytkownika do profili firmowych wewnątrz zamkniętych usług Google. Najmocniej odczuwają to branże oparte na konkretnych usługach i lokalizacji. W sektorze podróży aż 53,18% wskazywanych źródeł to wewnętrzne zasoby korporacji. Podobnie sytuacja wygląda w kategorii rozrywki i hobby, gdzie współczynnik ten sięga 49%, oraz w nieruchomościach, przekraczając barierę 30%. Wydawcy i właściciele mniejszych serwisów stają przed murem, którego nie da się przeskoczyć samą jakością treści, gdy algorytm promuje własne „podwórko”.

Amerykański filtr i algorytmiczne halucynacje

Problem z obiektywizmem sztucznej inteligencji nie kończy się jednak na faworyzowaniu własnych usług. Jak zauważa agencja Semcore, badania opublikowane przez Social Science Research Network (SSRN) wskazują na głęboką stronniczość geograficzną modeli językowych. W przypadku modelu Gemini aż 74,5% błędnie dopasowanych wyników wskazywało na źródła pochodzące ze Stanów Zjednoczonych. Ten „amerykański filtr” sprawia, że użytkownicy z Europy czy Azji mogą otrzymywać odpowiedzi osadzone w obcej im rzeczywistości prawnej, kulturowej czy rynkowej, nawet jeśli zapytanie dotyczy lokalnych kwestii. Modele Google oraz OpenAI (twórcy ChatGPT) wykazują tendencję do uznawania podmiotów z USA za domyślne punkty odniesienia, co zniekształca globalny obraz informacji.

Do braku obiektywizmu dochodzi kwestia rzetelności, a raczej jej braku w sytuacjach podbramkowych. Zjawisko halucynacji (generowania przez model AI informacji całkowicie zmyślonych, ale brzmiących bardzo prawdopodobnie) pozostaje piętą achillesową trybów generatywnych. Mimo dostępu do sieci w czasie rzeczywistym, AI Mode potrafi tworzyć fałszywe fakty, szczególnie w niszowych tematach naukowych oraz skomplikowanych zagadnieniach prawnych. Niepokojąca jest również niestabilność tych odpowiedzi. Średni poziom pokrycia tych samych adresów URL przy trzykrotnym powtórzeniu identycznego zapytania wynosi zaledwie 9,2%. Oznacza to, że użytkownik niemal za każdym razem otrzymuje inny zestaw źródeł, co podważa zaufanie do wyszukiwarki jako do stabilnego archiwum wiedzy.

Nowa era rywalizacji o udział w odpowiedziach AI

W obliczu tych zmian tradycyjne podejście do pozycjonowania stron internetowych (SEO) zaczyna tracić na znaczeniu. Marcin Stypuła z agencji SEO Semcore zauważa:

Walka o pozycję w wynikach wyszukiwania stopniowo zmienia się w rywalizację o „Share of LLM”, czyli udział w odpowiedziach generatywnych. Firmy powinny wdrażać nowe strategie zwiększające widoczność dla modeli językowych.

Zdaniem eksperta, dzisiejszy marketing wymaga wyjścia poza ramy własnej witryny.

Nadszedł czas, żeby marketingowcy monitorowali wzmianki o swoich produktach wewnątrz odpowiedzi AI, bo to tam dzisiaj zapadają decyzje zakupowe i kształtują się opinie konsumentów – dodaje Stypuła.

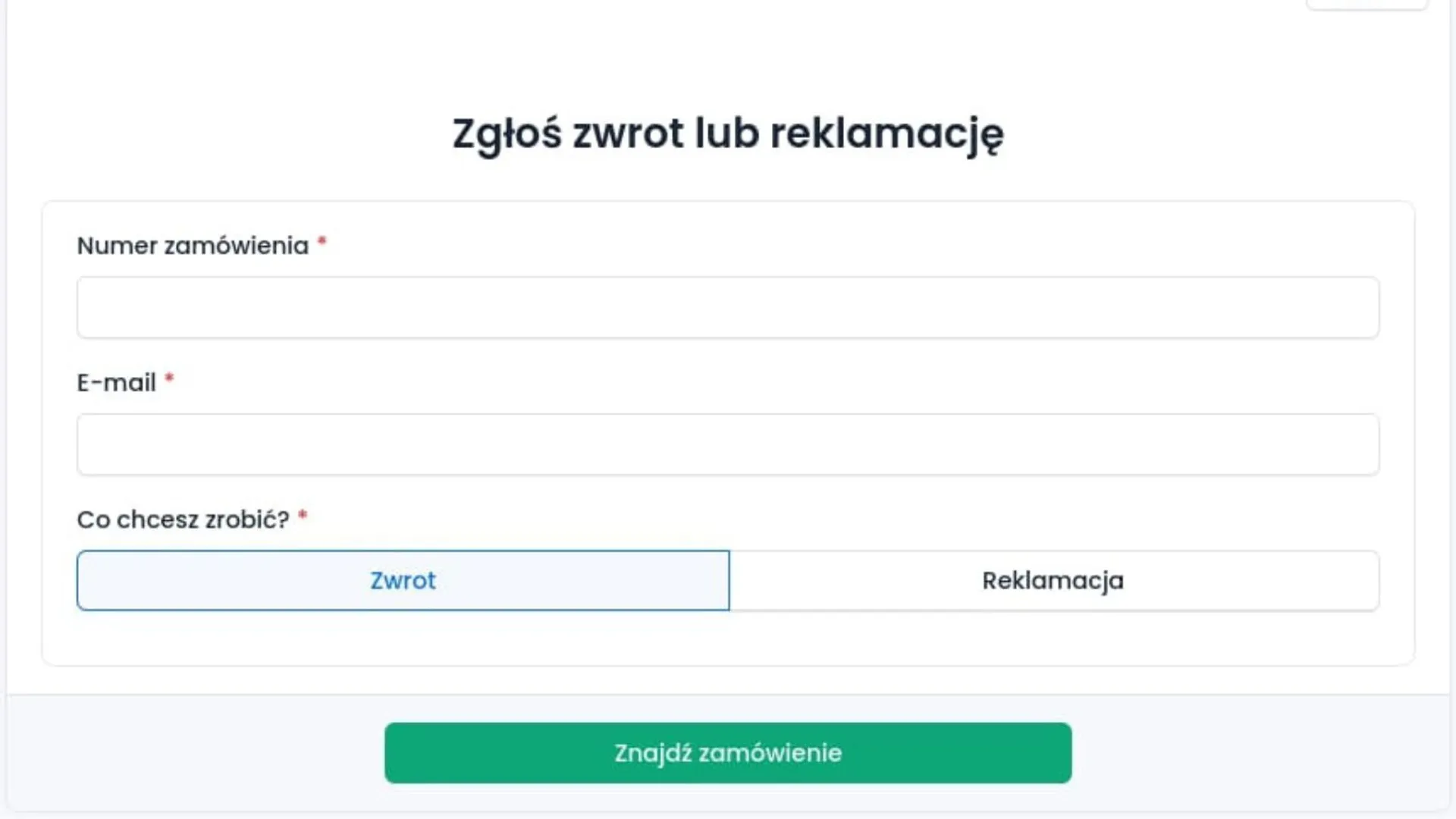

Bezkrytyczne poleganie na odpowiedziach z modeli LLM w kontekście opisanych problemów naraża nas na błędy, które mogą mieć dotkliwe konsekwencje. Największym zagrożeniem jest podejmowanie decyzji inwestycyjnych lub zakupowych na podstawie halucynacji. Model może zmyślić korzystną cenę akcji lub parametry produktu, których w rzeczywistości nie ma. Ze względu na wspomniany „amerykański filtr”, polski przedsiębiorca może otrzymać błędną interpretację przepisów podatkowych, opartą na prawie z USA, co grozi dotkliwymi karami. Co więcej, faworyzowanie własnych zasobów przez Google sprawia, że użytkownik często omija tańsze lub lepsze oferty zewnętrznych dostawców, przepłacając za usługi „podpowiadane” przez algorytm.

Źródła: BiznesInfo.pl/Agencja SEO Semcore